7月29日消息,据《华尔街日报》报道,为了解决对用于人工智能(AI)推理的系统功耗的担忧,超大规模云服务提供商 (CSP) Cloudflare 正在测试各种 AI 加速器,这些加速器不是 AMD 或 英伟达(Nvidia) 的 AI GPU。而根据测试显示,Cloudflare开始试用的 Positron AI的 Atlas 解决方案,其推理性能优于英伟达H200,但功耗只有英伟达H200的33%。

据介绍,Positron AI 是一家总部位于美国的AI芯片公司,成立于 2023 年,开发专门专注于推理的AI加速器。与专为 AI 训练、AI 推理、技术计算和各种其他工作负载而设计的通用 GPU 不同,Positron AI 的硬件是从头开始构建的,可以高效地以最低的功耗执行推理任务。

Position AI 针对大规模变压器模型的第一代解决方案称为 Atlas,它包含八个 Archer 加速器,旨在击败 英伟达基于 Hopper 的系统,同时消耗很少的功率。

据报道,Positron AI 的 Atlas 在 Llama 3.1 8B 中每个用户每秒可以提供大约 280 个Token,BF16 计算功率为 2000W,而 8 路 英伟达 DGX H200 服务器在同一场景中每个用户每秒只能实现大约 180 个Token,同时功率高达 5900W 。

Positron AI Atlas与英伟达的 DGX H200 系统相比,其每瓦性能和每美元性能方面的效率是DGX H200的三倍。

值得注意的是,Positron AI 在台积电位于亚利桑那州的Fab 21晶圆厂制造了ASIC硬件(即使用N4或N5工艺技术),并且这些卡也在美国组装,这使得它们几乎完全是美国产品。尽管如此,由于 ASIC 与 32GB HBM 内存配合使用,因此它使用了先进的封装技术,因此它可能是在中国台湾进行的先进封装。

Positron AI 的 Atlas 系统和 Archer AI 加速器与 Hugging Face 等广泛使用的 AI 工具兼容,并通过与 OpenAI API 兼容的端点提供推理请求,使用户能够在不对工作流程进行重大更改的情况下采用它们。

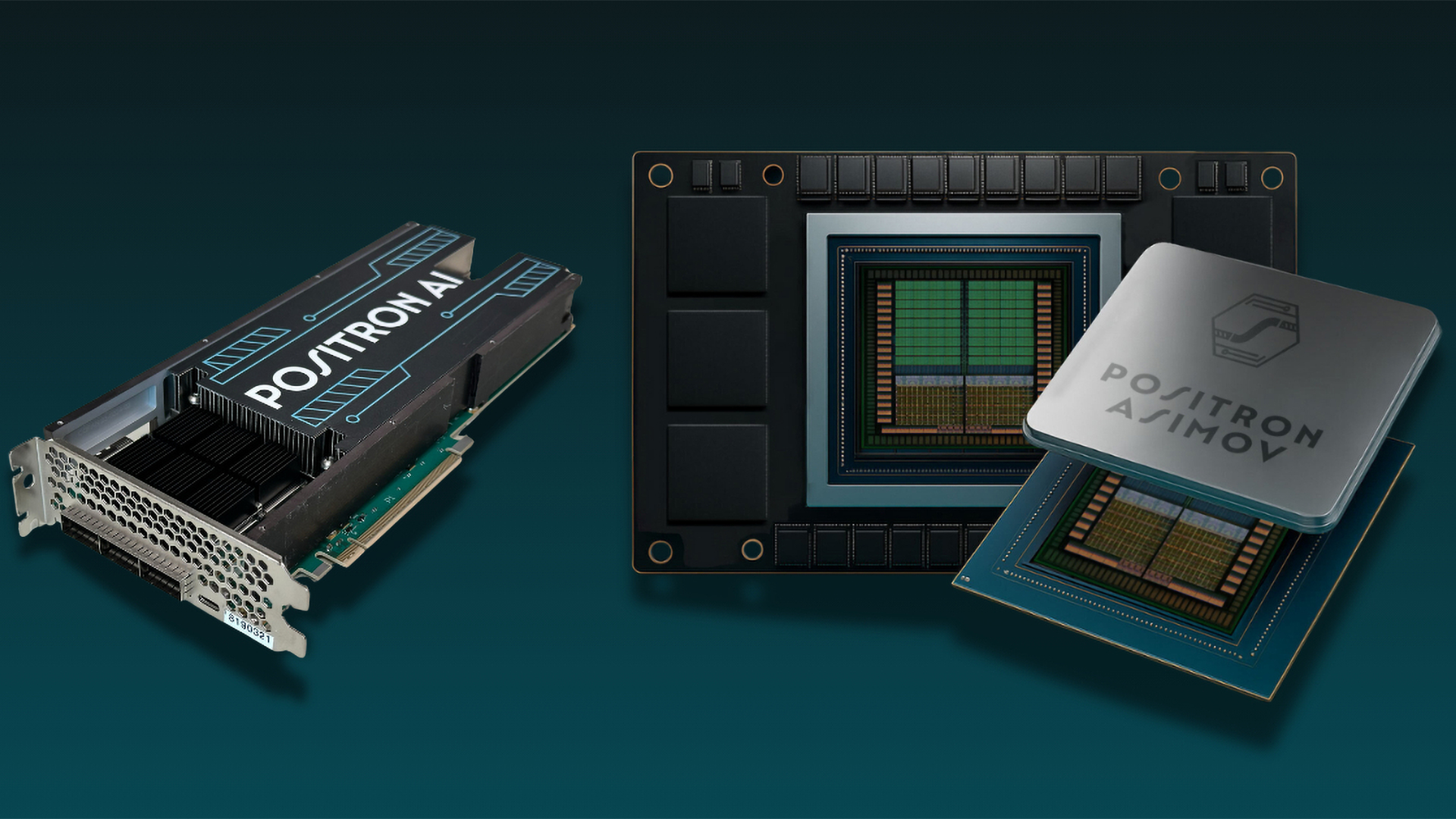

Positron AI 已筹集超过 7500 万美元的总资金,其中包括最近由 Valor Equity Partners、Atreides Management 和 DFJ Growth 等投资者领投的 5160 万美元融资。该公司还在开发名为 Asimov 的第二代 AI 推理加速器,这是一款 8 路 Titan 机器,预计将于 2026 年与基于英伟达Vera Rubin 平台的推理系统竞争。

Positron AI 的 Asimov AI 加速器将为每个 ASIC 配备 2 TB 内存,并且根据该公司发布的图片,将停止使用 HBM,而是使用另一种类型的内存。ASIC 还将具有 16 Tb/s 的外部网络带宽,可在机架级系统中更高效地运行。Titan 基于八个总内存为 16 GB 的 Asimov AI 加速器,预计能够在单台机器上运行具有多达 16 万亿个参数的模型,从而显着扩展了大规模生成式 AI 应用程序的上下文限制。据 Positron AI 称,该系统还支持同时执行多个模型,消除了每个 GPU 一个模型的限制。

编辑:芯智讯-林子