8月5日消息,据外媒wccftech报道,自2022年人工智能(AI)芯片市场繁荣以来,英伟达(NVIDIA)一直主导着AI芯片市场,但是 AMD在CEO苏姿丰(Lisa Su)的领导下,其AI产品线正在显著扩大,份额也在稳步增长。显然,这个市场的竞争将会变得更加激烈。

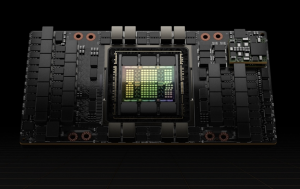

英伟达作为最早进入AI芯片市场并提供全套解决方案的公司,经过十多年的发展已经建立了强大的生态系统优势。而AMD和英特尔等竞争对手此前仍一直停留在CPU、GPU、NPU等产品的竞争上。而随着以ChatGPT为代表的生成式AI市场的爆发,AMD便开始迅速全面转向了人工智能,不过那时英伟达已经凭借其 Ampere 和 Hopper 解决方案以及强大的软件生态系统垄断了市场,对于AMD来说这将是一个巨大的挑战。

在 2023 年,从英伟达的AI解决方案转向其他供应商并不是一件容易的事,因为英伟达有他们所需要的强大的AI芯片及解决方案,为了抓住市场机遇,它们的选择也是以性能为优先,而不太会去考虑其他替代方案。

此外,凭借英伟达的 CUDA 和其他服务创建的“专有”生态系统,在英伟达CEO黄仁勋的领导下,大型科技公司都在与英伟达合作,这也成为了其他竞争对手难以进入竞争的一个市场,客户无法选择 AMD 等公司。这也导致了AMD在客户采用方面面临困难,尽管当时AMD推出了Instinct MI300系列 AI 加速器等解决方案。

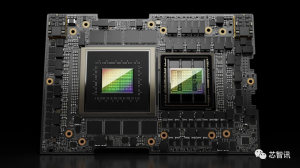

Instinct MI300 系列是AMD 的第一个主要人工智能解决方案,据称可以与英伟达广受欢迎的 H100 相媲美。它的HBM容量是 NVIDIA 同类产品的两倍,内存带宽相当,更重要的是,它采用了 CDNA 3 架构,有望带来巨大的性能提升。内部结果确实表明,MI300X 对英伟达H100构成了威胁,尤其是在推理应用方面,但这里的关键问题不是单纯靠芯片性能击败英伟达,而是要面对其整个生态系统的竞争。

竞争不仅仅是引入强大的芯片,生态系统至关重要

英伟达的CUDA生态系统阻碍了客户对于AMD AI解决方案的采用。英伟达对开发人员工具和 AI 框架有着严格的控制,将该公司定位为满足客户AI 需求的“默认场所”,而 AMD 则属于该系统之外的挑战者。由于建立AI基础设施不仅仅是获取数百万个AI芯片,它还需要考虑到整个生态系统。对于大型科技公司来说,相对于使用英伟达AI芯片来说,转向 AMD 的AI芯片是一项更昂贵的冒险,尽管AMD也提供了更多的功能。

虽然许多人可能不同意,但投资者/媒体的炒作往往会推动公司的决策,在这种情况下,英伟达看到了一个非常好的“甜蜜点”。大型科技公司在各自的公关声明中提到了英伟达的设备,这不仅增强了投资者的信心,而且还为公司带来了巨大的优势,因为英伟达的芯片被视为首选解决方案。因此,在某些情况下,如果像 OpenAI 或 微软(Microsoft)这样的公司宣布购买 AMD 的AI芯片,通常的零售商会认为这是一个低于标准的发展,因此AMD 也确实存在品牌形象问题。

在这种情况下,AMD 别无选择:要么持续提升解决方案的竞争力,要么完全放弃竞赛。但苏姿丰选择继续竞争,这就是为什么 AMD 在高性能计算及AI解决方案方面与英伟达相提并论的原因。有了这个,大型科技公司正在做出相应的反应,因为他们需要跟随炒作来跟上巨大的资本支出。

Microsoft、OpenAI、Meta 现在也AMD 的船上

在英伟达市值达到数万亿美元时,AMD 的AI业务价值还几乎是从零开始。在推出功能强大的产品后,该公司开始通过提供有竞争力的价格、更高的可用性和强大的生态系统来向大型科技公司推销它们。众所周知,AMD 的 Instinct MI300 系列通常比英伟达的同类产品便宜 20%-30%,性价比要高得多,这就是为什么,Microsoft 和 OpenAI 等公司也开始采用了AMD的解决方案。

但大型科技公司对 AMD 的投资达不到对英伟达AI芯片那样的投资规模,考虑到目前 AMD 还有很多工作要做才能与其主要竞争英伟达对手竞争,这可能是意料之中的。

值得注意的是,在今年6月的“Advancing AI 2025”大会,AMD正式发布了Instinct MI350系列GPU加速器,并披露了下一代AI加速器MI400系列。其将基于2nm制程,集成432GB的HBM4内存,内存带宽将达19.6TB/s,单个GPU的横向扩展带宽也将高达300GB/s,而MI400 GPU的算力将高达FP4数据格式下40PFLOPS、FP8格式下20PFLOPS,AI计算能力相比MI355X系列高出2倍,HBM4带宽增加近2.5 倍,推理性能增加10倍。相比英伟达Rubin GPU带来了更强的竞争力。并且,AMD还将带来机架级解决方案——“Helios”AI 服务器机架,该机架将采用 EPYC Venice CPU,并据称可以与 英伟达Rubin NVL144 竞争。

从目前来看,AMD已经准备好了与英伟达展开更加深入的竞争,除了更好出色的产品竞争力之外,AMD还通过ROCm软件继续深化Instinct GPU对前沿AI模型的支持。根据AMD披露的数据显示,得益于ROCm 7的加持,相比于上一代的ROCm 6,Llama 3.1 70B的推理性能提升到了原来的3.2倍,Qwen 2-72B的推理性能提升到了原来的3.4倍,DeepSeek R1的推理性能提升了到了原来的3.8倍。即便是对比基于CUDA的英伟达B200 GPU,在开源的ROCm 7的加持下,AMD MI355X的FP8吞吐量也取得了30%的优势。

为了进一步丰富基于AMD AI解决方案的软件生态系统,AMD还宣布向全球开发者和开源社区广泛提供AMD开发者云。专为快速、高性能的人工智能开发而构建,用户将可以访问一个完全托管的云环境,该环境具有工具和灵活性,可以开始人工智能项目,并无限增长。

凭借强大的AI芯片、ROCm 7和AMD开发者云,AMD正在降低障碍,扩大对下一代计算的生态。与Hugging Face、OpenAI和Grok等领导者的战略合作正在证明共同开发的开放解决方案的力量。OpenAI已经宣布计划采用AMD MI450芯片。

分析师预计,在 OpenAI 和其他公司的采用以及多个细分市场的需求的推动下,AMD收入将同比增长。仅在人工智能领域,AMD 预计将表现出积极性,但在与 NVIDIA 竞争时,您希望处于绝对最佳状态。

编辑:芯智讯-浪客剑