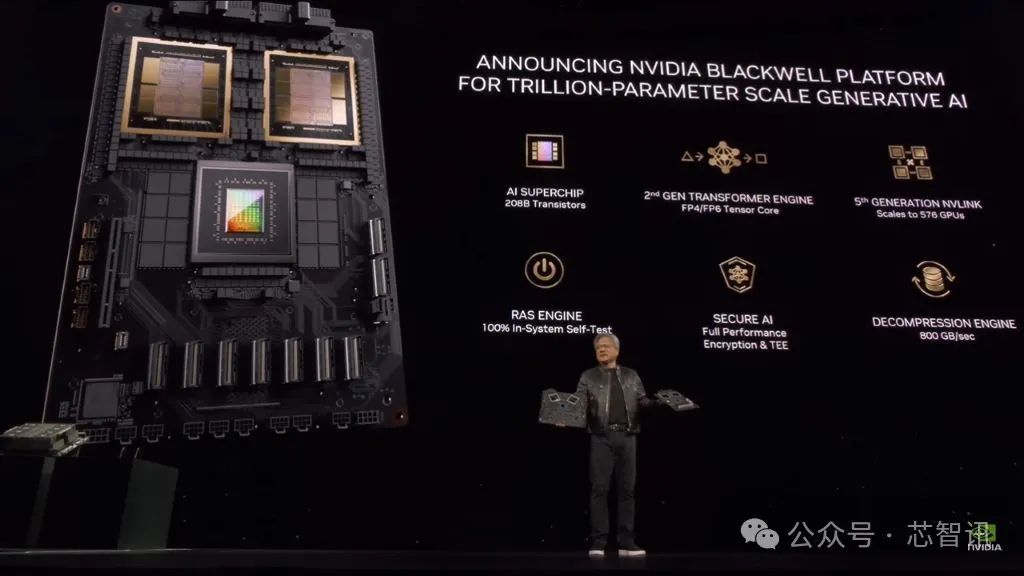

4月1日消息,据外媒报道,对于英伟达(NVIDIA)不及前推出的最强AI芯片GB200,有外资投行预测,英伟达明年的AI超级芯片出货目标600~650 万颗,GB200预计将会在明年英伟达出货当中占据70%份额,而GH200则将占据30%的份额。

资料显示,GB200是由两颗B200 GPU与一颗Grace CPU芯片封装而成,并在1颗B200芯片功耗高达1,000瓦至1,200瓦功耗的情况下,将首度采用水冷散热技术,这也成为了市场关注的焦点,该外资投行出具的最新报告也分析了NVIDIA GH/GB200超级芯片的供应链。

报告称,英伟达GB200服务器主要将会分为NVL36及NVL72两类,并预计出货将以NVL36为主,而NVL36的机柜(rack)约150~200万美元,至于NVL72的价格则为NVL36的1.8倍。

散热方面,每个GPU可能将需要花费300美元在散热上,这与市场预估的2000美元要少很多。不过,市场传闻,GB200的整体散热方案需要4~8万美元,每个元件至少有4家供应商,预估价格理应不会太高,但CSP(云端服务供应商)不会从每家都采购,或者是一定要完整解决方案,因此个个有机会,但个个没把握。

外资投行表示,英伟达自研的Grace CPU,属于Arm构架,之前CSP厂商想用ASIC或x86构架,但从英伟达GTC 2024大会推出后,CSP客户大多给予正面响应,从CP值来看,每花1美元得到的算力更好,而且英伟达也会提供x86架购产品。

在GB200系列的封装方面,目前仍是以台积电CoWoS为主。外资表示,但今年英伟达也会新增Amkor(艾克尔)及 英特尔 作为其先进封装供应商,合计与台积电将各占一半的份额,明年英伟达的出货目标为600~650万颗,其中用GB200将会占据70%,算起来大约为5.8-11.7万个机柜,今年约400~450万颗。

在GB200服务器的组装方面,外资表示,鸿海的份额可能会是最大的,另外纬创为Tier1,至于广达则算是Tier2。但CSP不会放弃ASIC,而且时间拖越久,性能未能急剧提升,数量就会越来越少,预估今年训练模型的GPU,就会转为推理模型,使得ASIC数量可能就没办法上来。

外资强调,ASIC目前主要就是看亚马逊AWS、谷歌,其他的业绩表现都很差,而信骅近期提到通用服务器订单陆续恢复,公司预期CSP客户可能降低前一世代的AI服务器采购,等待GB200出货,因此先将今年预算用在通用服务器采购,代表H100既有ODM及ASIC AI供应链有下修风险。

编辑:芯智讯-林子