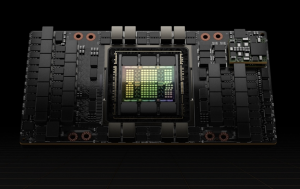

6月5日消息,据路透社报道,根据非营利机构MLCommons最新出具的AI系统性能报告显示,英伟达(NVIDIA)最新一代Blackwell GPU芯片的AI模型训练速度超过了上一代Hopper GPU的两倍以上。

根据报告显示,在利用英伟达、AMD等厂商的AI芯片针对Meta旗下4,050亿参数“Llama 3.1”等人工智能模型的训练中,2,496颗Blackwell芯片只花27分钟就完成AI模型的训练任务。相较之下,Hopper芯片需要三倍以上的数量,完成训练的时间才能略快一些。

与英伟达合作产出上述部分性能测试结果的CoreWeave产品负责人Chetan Kapoor表示,AI产业如今逐渐倾向把一小群芯片串接成次系统,用来进行不同的AI训练任务,而不是像过去那样打造动辄100,000颗同质芯片(甚至更多)的巨大训练丛集。

Kapoor说,那些参数规模达到上万亿参数的巨大AI模型,只要通过这种方式,就能加快或减少训练时间。

值得注意的是,据Barron’s报导,英伟达加速运算部门负责人Ian Buck 4日在美银全球科技大会(BofA Securities Global Technology Conference)上表示,AI推论(Inference)出现爆炸性需求,主要是受到自动推理(reasoning)的模型日渐获得应用带动。他说,推理功能“增添了非常多价值”。

编辑:芯智讯-浪客剑

0